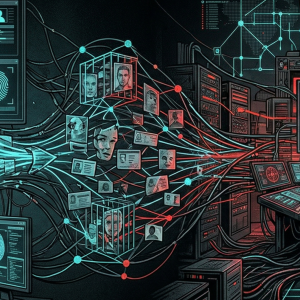

Durante casi una década, los profesionales de la ciberseguridad industrial han operado bajo un paradigma relativamente estable, sustentado en dos grandes pilares taxonómicos. Por un lado, el framework MITRE ATT&CK para sistemas de control industrial (ICS) nos proporcionaba un lenguaje común para describir las tácticas y técnicas de un adversario que buscaba manipular un controlador lógico programable o interrumpir un proceso de supervisión, control y adquisición de datos. Por otro lado, y más recientemente, el framework MITRE ATLAS comenzó a catalogar las amenazas específicas contra los pipelines de machine learning, desde el envenenamiento de datos hasta la evasión de modelos. Sin embargo, lo que la comunidad científica ha comenzado a evidenciar en los últimos meses es que ambos mapas, por sí solos, son insuficientes. Existe una zona de intersección, un territorio gris no cartografiado, donde un adversario puede utilizar una vulnerabilidad en la capa de inteligencia artificial para provocar un efecto catastrófico en el mundo físico. Esta laguna taxonómica no es un mero ejercicio académico; es el vector de ataque más peligroso que la industria ha ignorado sistemáticamente.

.

El problema de fondo reside en la creciente dependencia de los sistemas de control industrial de algoritmos predictivos para la optimización de procesos. Imaginemos una planta química que ha implementado un sistema de mantenimiento predictivo basado en redes neuronales profundas. Este modelo recibe alimentación continua de cientos de sensores de temperatura, presión y flujo, y su función es sugerir al operador humano los setpoints óptimos para cada variable de proceso. Un atacante con suficiente conocimiento del dominio podría ejecutar una técnica de envenenamiento de datos, catalogada en MITRE ATLAS como AML.T0020, introduciendo valores anómalos pero sutilmente corruptos en el historial de entrenamiento del modelo. El algoritmo, al aprender de esta basura, comenzaría a recomendar temperaturas de operación peligrosamente altas para un reactor químico. El operador humano, confiando ciegamente en la «inteligencia» del sistema que se le ha vendido como infalible, ejecuta la orden. En ese instante, se ha materializado una manipulación de control, descrita en MITRE ATT&CK for ICS como T0831, sin que el atacante haya escrito una sola línea de código malicioso en el controlador. El informe «Cyber Insights 2026» publicado por SecurityWeek en febrero de este año documentó que los ataques asistidos por inteligencia artificial crecieron un 72 por ciento durante 2025, y varios equipos de respuesta a incidentes ya han confirmado que la convergencia entre la manipulación de modelos y la manipulación de procesos físicos es técnicamente factible en entornos de producción actuales.

.

Lo que hace particularmente perturbadora esta nueva clase de amenazas es la asimetría fundamental entre los entornos de tecnología de la información y los entornos de tecnología operacional. En una red corporativa tradicional, un sistema de detección de intrusiones puede bloquear tráfico sospechoso con un margen de error razonable; un falso positivo puede significar una molestia para un empleado, pero rara vez pone en riesgo vidas humanas o infraestructura crítica. En una planta industrial, sin embargo, las reglas son radicalmente distintas. Un falso positivo que interrumpa un proceso de fundición de acero o que detenga una línea de ensamblaje puede costar millones de dólares por minuto, y en el peor de los casos, puede provocar un accidente catastrófico. Por esta razón, los principios operativos en entornos OT han sido tradicionalmente conservadores: alertar siempre, pero bloquear solo bajo autorización expresa del personal de ingeniería de procesos. La inteligencia artificial maliciosa explota precisamente esta cautela. El adversario no necesita inyectar un comando hostil que active una alarma; solo necesita que el modelo, corrompido por datos envenenados, sugiera una acción que el operador humano ejecutará de buena fe.

.

La métrica que realmente debería preocupar a los gestores de riesgo es lo que algunos investigadores han comenzado a denominar el «Convergence Gap». Este indicador mide el porcentaje de vectores de ataque que combinan una técnica de manipulación de IA (como el envenenamiento de modelos o la inyección de adversarios) con una técnica de impacto físico en ICS que son técnicamente factibles, pero para los cuales no existe ninguna regla de detección implementada en las defensas actuales. Según un análisis presentado en la conferencia S4x25, ese gap es prácticamente del cien por cien en la mayoría de las organizaciones. Salvo en casos muy específicos de evasión de antivirus basados en machine learning, como el famoso caso Cylance documentado por investigadores independientes en 2024, no existen firmas, reglas o modelos de detección entrenados para identificar cuándo un algoritmo de mantenimiento predictivo está siendo manipulado para provocar una falla. La ventana de oportunidad para los defensores es angosta. La historia de la ciberseguridad industrial nos ha enseñado que los vectores de ataque teóricos tarde o temprano se materializan en exploits operativos, como ocurrió con Stuxnet en 2010 o con Industroyer2 en 2022. La diferencia es que ahora el adversario no necesita ser un experto en protocolos industriales; solo necesita ser un experto en manipular la confianza que depositamos en nuestras máquinas inteligentes.

.

Para más contenido como este, únete a nuestra comunidad de Informática Forense, Pentester, Osint y Jurídico. Telegram: LAZARUS_VENEZUELA