.

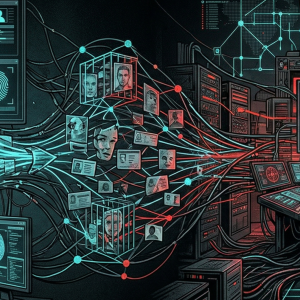

Frente a un adversario que utiliza inteligencia artificial para mapear nuestras defensas en segundos, identificar la ruta de menor resistencia y ejecutar ataques a velocidades sobrehumanas, las estrategias de seguridad reactivas están condenadas al fracaso. Esta constatación, que ha ido ganando aceptación en los círculos más avanzados de la profesión, está impulsando la adopción de dos disciplinas complementarias que hasta hace muy poco eran consideradas marginales o excesivamente experimentales. La primera es la ingeniería del caos aplicada a la seguridad, conocida como Security Chaos Engineering o SCE. La segunda es la ingeniería del engaño, o Deception Engineering, que ha evolucionado desde simples honeypots hasta ecosistemas enteros de señuelos gestionados por inteligencia artificial. Ambas disciplinas comparten un principio fundamental: en lugar de intentar construir un muro infranqueable, lo que es imposible, debemos construir un laberinto dinámico que confunda, retrase y en última instancia disuada al adversario.

.

La ingeniería del caos en seguridad toma prestados sus principios de la ingeniería de resiliencia de sistemas distribuidos, popularizada por empresas como Netflix en la última década. La idea central es simple pero poderosa: en lugar de esperar a que un atacante real provoque una falla, los equipos de seguridad inyectan fallos controlados en sus propios entornos de producción para probar sus defensas. Durante 2025 y lo que va de 2026, los equipos de seguridad más maduros han dejado de realizar simulacros de mesa predecibles, donde todos los participantes saben que están en un ejercicio, para pasar a experimentos de caos reales. Estos experimentos consisten en inyectar comportamientos anómalos en la red, simular la desconexión de servidores de autenticación o incluso ejecutar versiones controladas de malware real en segmentos aislados. El objetivo es probar hipótesis concretas, como por ejemplo: «si un agente de inteligencia artificial malicioso compromete nuestro sistema de inicio de sesión único, nuestro sistema de detección de anomalías lo aislará en menos de 15 segundos». Si la hipótesis es falsa, el equipo de seguridad lo descubre en un entorno controlado, no durante un ataque real. Los informes de tendencias para 2026 recomiendan encarecidamente la adopción de estas prácticas, ya que permiten entrenar a los agentes de inteligencia artificial defensivos en entornos hostiles antes de que llegue el adversario real, de la misma manera que los pilotos de combate entrenan en simuladores antes de enfrentarse a un enemigo real.

.

La ingeniería del engaño ha experimentado una evolución aún más radical. Los honeypots tradicionales eran sistemas señuelo relativamente sencillos, diseñados para atraer a los atacantes y estudiar sus técnicas. Un adversario mínimamente experimentado podía identificar un honeypot por su falta de tráfico legítimo o por la ausencia de datos reales. La nueva generación de sistemas de engaño, potenciada por inteligencia artificial, ha superado estas limitaciones. Hablamos ahora de ecosistemas enteros de señuelos: documentos trampa incrustados con «canary tokens» que alertan silenciosamente al centro de operaciones de seguridad cuando son abiertos; credenciales falsas que parecen perfectamente válidas para un infostealer pero que en realidad son cepos que delatan al adversario; bases de datos de datos sintéticos que envenenan al atacante con información falsa si intenta exfiltrarlas. En un contexto de inteligencia artificial, estas técnicas son especialmente efectivas porque explotan la confianza algorítmica. Un agente autónomo que ha logrado acceso a la red, al encontrar un archivo etiquetado como «facturación_2025_clientes_vip.xlsx», asumirá que es un activo valioso y lo priorizará para su exfiltración. Solo cuando el archivo se abre en el entorno del adversario, el canary token incrustado envía una señal que no solo alerta al defensor, sino que también puede proporcionar información forense valiosa sobre el adversario: su dirección IP real, la cadena de herramientas que utilizó y los servidores de comando y control a los que se conecta.

.

El objetivo último de estas estrategias de defensa activa es cambiar la economía del ataque. Los adversarios, ya sean humanos o agentes autónomos, operan bajo restricciones de recursos. Tienen un tiempo limitado antes de que su presencia sea detectada, y una capacidad computacional limitada para validar la veracidad de los datos que roban. Si un defensor puede hacer que el adversario gaste el doble de tiempo validando cada dato exfiltrado, o que el agente autónomo se pierda en un laberinto de señuelos mientras los sistemas reales permanecen a salvo, la operación del atacante deja de ser rentable. El adversario buscará entonces un objetivo más fácil. La ingeniería del engaño, en este sentido, no es solo una técnica defensiva; es una estrategia de disuasión. El desarrollo de estas técnicas está dando lugar a una nueva especialización forense que apenas comienza a definirse: el análisis de comportamiento de agentes. Cuando un canary token se activa, no basta con saber qué dirección IP lo tocó. Es necesario analizar el comportamiento completo del agente malicioso. ¿Intentó escalar privilegios inmediatamente después de obtener el documento? ¿Utilizó herramientas específicas de living off the land? ¿Mostró patrones de exploración que sugieran que es un agente autónomo o un humano operando remotamente? Esta información es vital para actualizar los modelos predictivos de las plataformas de inteligencia de amenazas y para entrenar a los agentes defensivos en las tácticas emergentes.

.

El futuro de la ciberseguridad, si estos pronósticos son correctos, no se jugará en tener el muro más alto o la puerta más gruesa. Esas estrategias, que dominaron la disciplina durante décadas, han demostrado su insuficiencia frente a adversarios que pueden encontrar la rendija más pequeña y explotarla en milisegundos. El futuro se jugará en construir una ciudad laberíntica llena de espejos y trampas, donde el invasor, por muy inteligente que sea la máquina que lo guía, no pueda distinguir lo real de lo ficticio. En 2026, la mejor defensa no es una fortaleza inexpugnable, porque esa fortaleza no existe. La mejor defensa es una mentira bien construida, gestionada por algoritmos que nunca duermen y que aprenden continuamente de los movimientos del adversario para tenderle nuevas trampas en cada esquina. La ingeniería del caos y el engaño nos invitan a repensar por completo nuestra relación con el adversario: ya no como un muro que debemos defender, sino como un juego que debemos ganar confundiendo sus sentidos algorítmicos. Y en ese juego, la ventaja es para quien mejor sabe mentir.

.

Para más contenido como este, únete a nuestra comunidad de Informática Forense, Pentester, Osint y Jurídico. Telegram: LAZARUS_VENEZUELA