.

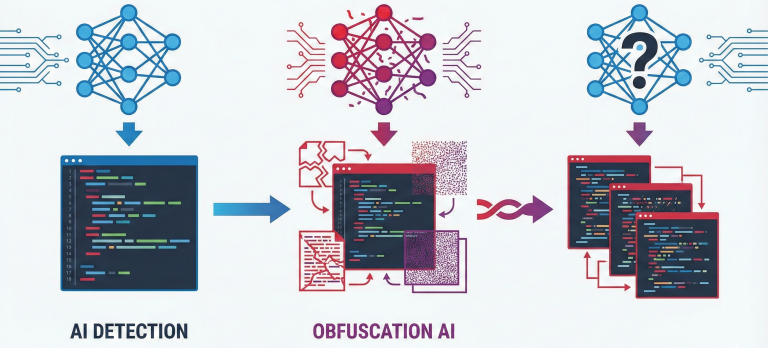

La Inteligencia Artificial (IA) se ha consolidado como la columna vertebral de nuestra infraestructura digital, impulsando sistemas críticos desde la detección de fraudes hasta la tecnología de vehículos autónomos. Tradicionalmente, la seguridad de los modelos de IA se ha centrado en proteger la propiedad intelectual del modelo y los datos de entrenamiento contra la extracción (Model Extraction) o el envenenamiento (Data Poisoning). Sin embargo, en el panorama de amenazas actual, una nueva y sutil categoría de ataque está emergiendo, exigiendo una redefinición fundamental de las prácticas de pentesting: los ataques de ofuscación de modelos. Estos ataques no buscan la destrucción o el robo, sino alterar sutilmente el comportamiento predictivo del modelo para manipular sus resultados con fines maliciosos, evadiendo los checks de integridad convencionales.

.

El desafío de la ofuscación reside en la manipulación del espacio latente de una red neuronal, que es la representación interna, comprimida y de alta dimensión que la red utiliza para tomar decisiones. Aquí, el actor malicioso no inyecta el tradicional malware o shellcode, sino «noise» (ruido) diseñado matemáticamente y de manera meticulosa. Hablamos de un Ataque de Noise Adversario, donde algoritmos de generación de ejemplos adversarios crean una perturbación imperceptible para el ojo humano o los sistemas de validación de datos simples, pero con la capacidad precisa de forzar una clasificación errónea en el modelo. Un ejemplo ilustrativo se da en un sistema de detección de intrusos basado en IA: un atacante podría añadir bits de ruido a los paquetes de red, logrando que el modelo los clasifique incorrectamente como tráfico benigno, abriendo una puerta lateral para el movimiento lateral.

.

La vulnerabilidad se extiende más allá de las entradas directas del modelo para incluir el pipeline de datos completo. El threat actor podría comprometer un sensor o un feed de datos intermedio, alterando la telemetría de forma que la manipulación no sea detectable por checksums o reglas de validación básicas. Esta alteración, aunque silenciosa, podría ser suficiente para que un modelo de mantenimiento predictivo clasifique una falla inminente en un componente industrial como un estado operacional normal, lo que resulta en un fallo catastrófico. El éxito de esta ofuscación depende de la comprensión profunda de la arquitectura interna del modelo y de las funciones de pérdida que guían su entrenamiento, lo que permite al atacante calcular el vector de ataque más eficiente.

.

Para un pentester moderno, la simulación de estos ataques de ofuscación requiere una caja de herramientas especializada que supere las capacidades de las herramientas tradicionales de seguridad de aplicaciones. La metodología debe incorporar activamente la generación de noise adversario, utilizando frameworks de IA como PyTorch o TensorFlow y métodos como el Fast Gradient Sign Method (FGSM) o Projected Gradient Descent (PGD). Además, se debe pasar de un fuzzing aleatorio a un fuzzing inteligente y dirigido. Este proceso implica el desarrollo de fuzzers capaces de inyectar noise específicamente en áreas sensibles del pipeline de datos y los embeddings latentes, basándose en la arquitectura de la red neuronal que se está auditando.

.

Podemos decir que el concepto de la ofuscación de modelos, a menudo referido metafóricamente como el «algoritmo fantasma», representa un nuevo y formidable paradigma para la ciberseguridad. Ya no es suficiente proteger la integridad de los datos en tránsito y en reposo. La frontera crítica de la seguridad se ha desplazado a asegurar la integridad de las decisiones autónomas tomadas por la IA. El pentesting del futuro debe formalizar la «auditoría de la IA» como una disciplina estándar, enfocándose en la simulación rigurosa de estos ataques de ofuscación para garantizar que nuestros sistemas automatizados sean resistentes a cualquier forma de manipulación sutil o silenciosa. La resiliencia organizacional dependerá directamente de nuestra capacidad para ver la IA no solo como un activo, sino también como un vector de ataque.

.

Para más contenido como este, únete a nuestra comunidad de Informática Forense, Pentester, Osint y Jurídico. Telegram: LAZARUS_VENEZUELA